Tóm tắt các ý chính

– NVIDIA H20 là “game-changer” trong thế giới AI enterprise với kiến trúc Hopper và 14,592 CUDA cores, mang đến hiệu suất xử lý song song vượt trội

– Tiết kiệm chi phí vận hành đáng kể với mức tiêu thụ điện chỉ 350W (giảm 50% so với H100), giúp doanh nghiệp cắt giảm hóa đơn điện và chi phí làm mát

– Tốc độ AI inference nhanh hơn 20% so với các GPU cao cấp khác, với hiệu suất lên đến 900 TFLOPS, lý tưởng cho ứng dụng AI thời gian thực

– Bộ nhớ khủng 96GB HBM3 với băng thông 4.0TB/s, xử lý được các mô hình AI lớn mà không gặp bottleneck

– Khả năng mở rộng linh hoạt với Multi-Instance GPU (MIG), cho phép chia sẻ tài nguyên cho nhiều ứng dụng và người dùng

– ROI hấp dẫn thông qua giảm chi phí infrastructure, tăng hiệu quả năng lượng và khả năng triển khai nhanh chóng

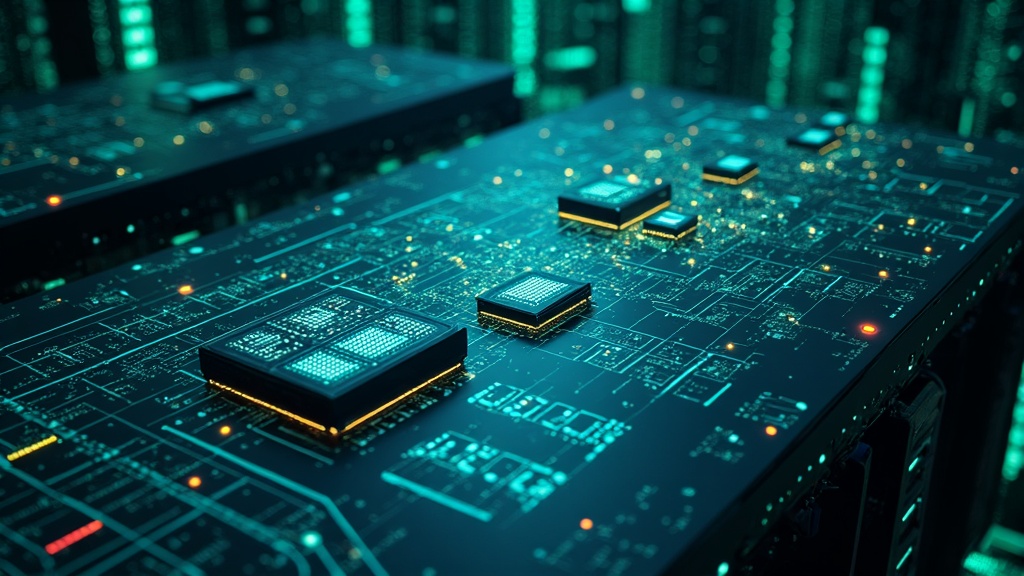

Bạn có bao giờ tự hỏi tại sao một số doanh nghiệp có thể triển khai AI nhanh như chớp, trong khi số khác vẫn đang loay hoay với các giải pháp chậm chạp và tốn kém? Câu trả lời có thể nằm ở chính “trái tim” của hệ thống AI – con chip xử lý.

NVIDIA H20 không chỉ là một chip GPU thông thường. Đây là câu trả lời của NVIDIA cho những CEO và CTO đang tìm kiếm một giải pháp AI vừa mạnh mẽ, vừa tiết kiệm, vừa dễ triển khai. Hãy cùng khám phá tại sao H20 đang được coi là “vũ khí bí mật” của các doanh nghiệp thông minh. Tìm hiểu thêm

Kiến trúc Hopper: Khi Công nghệ Gặp Kinh doanh

Hãy tưởng tượng bạn đang điều hành một nhà máy sản xuất. Thay vì có một dây chuyền duy nhất, bạn có đến 14,592 dây chuyền nhỏ hoạt động song song. Đó chính là cách kiến trúc Hopper của H20 hoạt động với 14,592 CUDA cores.

Tại sao điều này quan trọng với doanh nghiệp của bạn?

Khi khách hàng truy cập chatbot AI của công ty bạn lúc 9h sáng (giờ rush), hay khi hệ thống phân tích dữ liệu cần xử lý hàng nghìn giao dịch cùng lúc, những CUDA cores này đảm bảo không có ai phải chờ đợi. Mỗi core như một nhân viên chuyên nghiệp, xử lý một phần công việc một cách hiệu quả.

Tensor Cores thế hệ thứ 4: “Siêu não” cho AI

Nếu CUDA cores là những công nhân, thì Tensor Cores chính là những kỹ sư AI chuyên nghiệp. H20 trang bị Tensor Cores thế hệ thứ 4 với khả năng xử lý các phép tính AI phức tạp ở định dạng FP8 và FP16.

Điều này có nghĩa là gì? Hệ thống khuyến nghị sản phẩm của bạn có thể phân tích hành vi 10,000 khách hàng và đưa ra gợi ý cá nhân hóa trong vài millisecond, thay vì phải chờ vài giây như trước.

Sức mạnh Bộ nhớ: 96GB HBM3 – “Kho” Dữ liệu Siêu tốc

Bạn có biết tại sao nhiều hệ thống AI chạy chậm? Đó thường là do “traffic jam” dữ liệu. Giống như một siêu thị chỉ có một quầy thanh toán, dù có nhiều khách hàng đến mấy cũng phải xếp hàng dài.

H20 giải quyết vấn đề này bằng bộ nhớ HBM3 96GB với băng thông khủng 4.0TB/s. Tưởng tượng thay vì một quầy thanh toán, bạn có cả nghìn quầy hoạt động song song!

Ứng dụng thực tế:

- Phân tích khách hàng real-time: Xử lý được hàng triệu profile khách hàng để phân khúc thị trường tức thời

- Mô hình ngôn ngữ lớn: Chạy được ChatGPT-level chatbots ngay trên hạ tầng nội bộ, không cần dựa vào cloud service đắt đỏ

- Computer Vision: Phân tích hàng nghìn hình ảnh/video từ camera an ninh, chất lượng sản phẩm, hay hành vi khách hàng

Hiệu quả Năng lượng: Tiết kiệm 50% Chi phí Vận hành

Đây là điểm mà các CFO sẽ rất quan tâm. H20 chỉ tiêu thụ 350W so với 700W của H100 – giảm ngay 50% hóa đơn điện!

Tính toán thực tế:

Nếu doanh nghiệp bạn vận hành 10 máy chủ GPU 24/7:

- H100: 10 × 700W × 24h × 365 ngày = 61,320 kWh/năm

- H20: 10 × 350W × 24h × 365 ngày = 30,660 kWh/năm

- Tiết kiệm: 30,660 kWh/năm (khoảng 80-120 triệu VNĐ tùy giá điện)

Chưa kể chi phí làm mát data center cũng giảm tương ứng. Nhiệt thải ít hơn = ít máy lạnh hơn = ít tiền điện hơn!

Multi-Instance GPU: Một Chip, Nhiều Ứng dụng

MIG (Multi-Instance GPU) của H20 giống như việc biến một tòa nhà thành 7 văn phòng độc lập. Mỗi “instance” có thể chạy một ứng dụng AI khác nhau mà không ảnh hưởng lẫn nhau.

Kịch bản ứng dụng:

- Instance 1: Chatbot chăm sóc khách hàng (24/7)

- Instance 2: Hệ thống phân tích fraud (real-time)

- Instance 3: Dự báo nhu cầu sản phẩm (batch processing)

- Instance 4: Quality control bằng computer vision

- Instances 5-7: Development và testing môi trường

Thay vì mua 7 GPU riêng biệt (chi phí gấp 7 lần), bạn chỉ cần một H20!

Tối ưu hóa cho AI Inference: 20% Nhanh hơn, Chi phí Thấp hơn

H20 được thiết kế đặc biệt cho AI inference – việc sử dụng các mô hình AI đã được train để đưa ra dự đoán/quyết định. Đây chính là những gì doanh nghiệp cần hằng ngày.

So sánh với H100:

- Training AI models: H100 nhanh hơn (nhưng doanh nghiệp thường không tự train)

- AI Inference: H20 nhanh hơn 20% và rẻ hơn đáng kể

Điều này giống như so sánh giữa một siêu xe F1 (H100) với một chiếc Tesla Model S (H20). F1 nhanh hơn trên đường đua, nhưng Tesla lại tối ưu hơn cho việc di chuyển hằng ngày.

Tích hợp Hệ sinh thái: Plug-and-Play với CUDA

H20 hoàn toàn tương thích với hệ sinh thái NVIDIA CUDA – điều này có nghĩa là team IT của bạn không cần học lại từ đầu. Tất cả framework AI phổ biến như TensorFlow, PyTorch, hay các thư viện enterprise đều “nhận ra” và tối ưu tự động cho H20.

Lợi ích cho doanh nghiệp:

- Time-to-market nhanh: Triển khai AI solutions trong vài tuần thay vì vài tháng

- Chi phí training thấp: Team hiện tại có thể học nhanh chóng

- Ecosystem support: Hàng nghìn AI tools và services sẵn sàng sử dụng

Doanh nghiệp cũng có thể cân nhắc các bài học chuyển đổi số toàn diện, mở rộng hệ sinh thái AI mạnh mẽ để không tụt hậu và tăng trưởng bền vững. Tham khảo bài học

NVLink và Khả năng Mở rộng: Sẵn sàng cho Tương lai

Khi doanh nghiệp phát triển, nhu cầu AI cũng tăng theo. H20 hỗ trợ NVLink với băng thông lên đến 900GB/s, cho phép kết nối nhiều GPU thành một “siêu máy tính” AI.

Kịch bản mở rộng:

- Năm 1: 1 server với 2 H20 GPUs

- Năm 2: Thêm 1 server nữa (4 GPUs total)

- Năm 3: Scale lên 8-way HGX configuration

- Tương lai: Multi-node clusters cho enterprise-scale AI

Phân tích ROI: Tại sao H20 là Khoản đầu tư Thông minh

Chi phí ban đầu: H20 rẻ hơn đáng kể so với H100 nhờ thiết kế đơn giản hóa

Chi phí vận hành: Tiết kiệm 50% điện năng + giảm chi phí cooling

Hiệu suất: 20% nhanh hơn cho AI inference – core business use case

Tính linh hoạt: MIG cho phép tận dụng tối đa tài nguyên

Time-to-value: Tương thích hoàn toàn với ecosystem hiện tại

Ví dụ ROI cụ thể:

Một công ty e-commerce triển khai H20 cho hệ thống recommendation:

- Đầu tư: 200 triệu VNĐ (server + H20)

- Tiết kiệm vận hành: 100 triệu VNĐ/năm (điện + cooling)

- Tăng doanh thu: 300 triệu VNĐ/năm (conversion rate tăng 15%)

- Payback period: 6 tháng

Ứng dụng Thực tế Across Industries

Retail & E-commerce:

- Recommendation engines thời gian thực

- Fraud detection cho payment processing

- Inventory optimization dựa trên AI forecasting

- Visual search và product classification

Manufacturing:

- Predictive maintenance cho máy móc

- Quality control bằng computer vision

- Supply chain optimization

- Robot automation và process control

Financial Services:

- Real-time risk assessment

- Algorithmic trading

- Customer behavior analysis

- Compliance monitoring tự động

Healthcare & Pharma:

- Medical image analysis

- Drug discovery acceleration

- Patient data analytics

- Telemedicine AI assistants

Nền tảng AI inference mạnh mẽ giúp doanh nghiệp ứng dụng nhanh chóng vào mọi phòng ban và quy trình, từ chăm sóc khách hàng đến vận hành chuỗi cung ứng. Xem thêm kinh nghiệm triển khai AI của các doanh nghiệp Việt: Tại đây

Yếu tố Địa chính trị và Compliance

H20 được thiết kế đặc biệt để tuân thủ các quy định xuất khẩu quốc tế, đặc biệt quan trọng cho các doanh nghiệp đa quốc gia. Điều này đảm bảo:

- Không rủi ro compliance: Không lo bị ảnh hưởng bởi thay đổi chính sách

- Supply chain ổn định: Ít bị gián đoạn do trade restrictions

- Cost predictability: Giá cả ổn định, không bị biến động do địa chính trị

Thermal Management: Giải pháp Data Center Thông minh

Với TDP chỉ 350W, H20 tạo ít nhiệt hơn đáng kể, mở ra nhiều khả năng triển khai:

High-density deployments: Có thể đặt nhiều servers trong cùng một rack

Edge computing: Triển khai tại các location có hạ tầng cooling hạn chế

Hybrid cloud: Dễ dàng tích hợp với existing infrastructure

Kết luận: H20 – Lựa chọn Chiến lược cho Enterprise AI

NVIDIA H20 không chỉ là một upgrade technology thông thường. Đây là một strategic enabler cho digital transformation. Với sự kết hợp độc đáo giữa hiệu suất cao, chi phí thấp, và tính linh hoạt, H20 giúp doanh nghiệp:

- Accelerate innovation mà không cần đầu tư massive infrastructure

- Reduce operational costs thông qua energy efficiency

- Future-proof AI strategy với khả năng scale linh hoạt

- Minimize risks về compliance và supply chain

Câu hỏi không phải là liệu H20 có phù hợp với doanh nghiệp bạn hay không, mà là bạn có thể chậm trễ trong cuộc đua AI được bao lâu nữa. Trong thế giới business ngày nay, AI advantage là competitive advantage. Và H20 chính là cách thông minh nhất để có được lợi thế đó.

Nếu bạn muốn hiểu rõ hơn về ảnh hưởng của Nvidia đến thị trường toàn cầu và tại sao chip AI trở thành trung tâm đổi mới, hãy đọc thêm tại đây: Tác động toàn cầu của Nvidia

Next steps: Đánh giá AI readiness của tổ chức, xác định use cases ưu tiên, và bắt đầu pilot project với H20. Thời điểm tốt nhất để bắt đầu AI transformation là 3 năm trước. Thời điểm tốt nhì là hôm nay.

FAQ: Câu hỏi thường gặp về NVIDIA H20

H20 có phù hợp cho doanh nghiệp nhỏ không?

Có. Nhờ chi phí đầu tư và vận hành thấp, H20 đặc biệt phù hợp cả với các SME muốn ứng dụng AI mà không cần hạ tầng phức tạp.

H20 có hỗ trợ các framework AI phổ biến hiện nay?

Hoàn toàn tương thích với TensorFlow, PyTorch, Keras và các thư viện khoa học dữ liệu (scikit-learn, RAPIDS)

Hiệu suất thực tế của H20 với AI inference như thế nào?

Theo các benchmark, H20 nhanh hơn ~20% H100 ở bài toán inference và tiết kiệm điện hơn 2 lần.

Bảo hành và support của H20 ra sao?

Hợp tác cùng các nhà phân phối lớn tại Việt Nam đảm bảo bảo hành chính hãng 3 năm, hỗ trợ kỹ thuật tận nơi.

Nên chọn H20 hay H100?

Nếu chủ yếu phục vụ AI inference (triển khai thực tế), H20 là lựa chọn tối ưu về chi phí và năng lượng. H100 thích hợp hơn cho R&D/AI training quy mô lớn.

Lộ trình triển khai H20 cho doanh nghiệp như thế nào?

Hiện tại các hệ thống server đã hỗ trợ sẵn H20, có thể triển khai chỉ trong vài tuần kể từ khi lên kế hoạch.